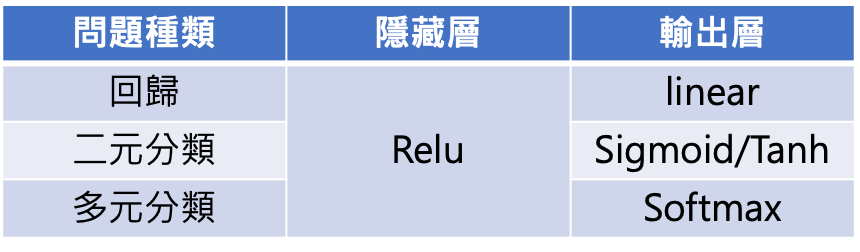

啟動函數選擇: 一表格讓您輕鬆掌握

這次跟大家分享的是用一個表格來統整針對不同問題種類與位置之適用的啟動函數。首先不管是在哪個問題種類,在隱藏層的部分,都是採用Relu函數,目的在於可以有效篩選掉不重要的特徵,保留重要特徵。在輸出層的部分,針對回歸問題,將採用線性函數,目的在於產生一連續數值。而針對二元分類問題,則是採用Sigmoid/Tanh函數,用來區分輸出到底是類別0或1。針對多元分類問題,則是採用Softmax函數,目的在於可以給出在多個類別當中,分出屬於某個類別的結果。

想要看更多AI文章,更了解學習脈絡,請參考AI學習路線圖。

[參考資料]:

2.機器學習與人工神經網路(二):深度學習(Deep Learning)

[相關文章]:

1.類神經網路(Deep neural network, DNN)介紹

5.類神經網路—反向傳播法(一): 白話文帶您了解反向傳播法

7.類神經網路—反向傳播法(三): 五步驟帶您了解梯度下降法

9.機器學習訓練原理大揭秘:六步驟帶您快速了解監督式學習的訓練方法

10.類神經網路—反向傳播法(五): 用等高線圖讓您對學習率更有感

[延伸閱讀]:

1.卷積類神經網路(Convolution neural network,CNN)介紹

9 Comments

Comments are closed.